OllamaFX: Cómo ejecutar modelos IA en tu PC sin regalar tus datos

¿Te preocupa que tus datos terminen en las nubes de ChatGPT o Gemini? Descubre cómo recuperar tu soberanía digital instalando modelos de IA (LLM) localm...

Tema

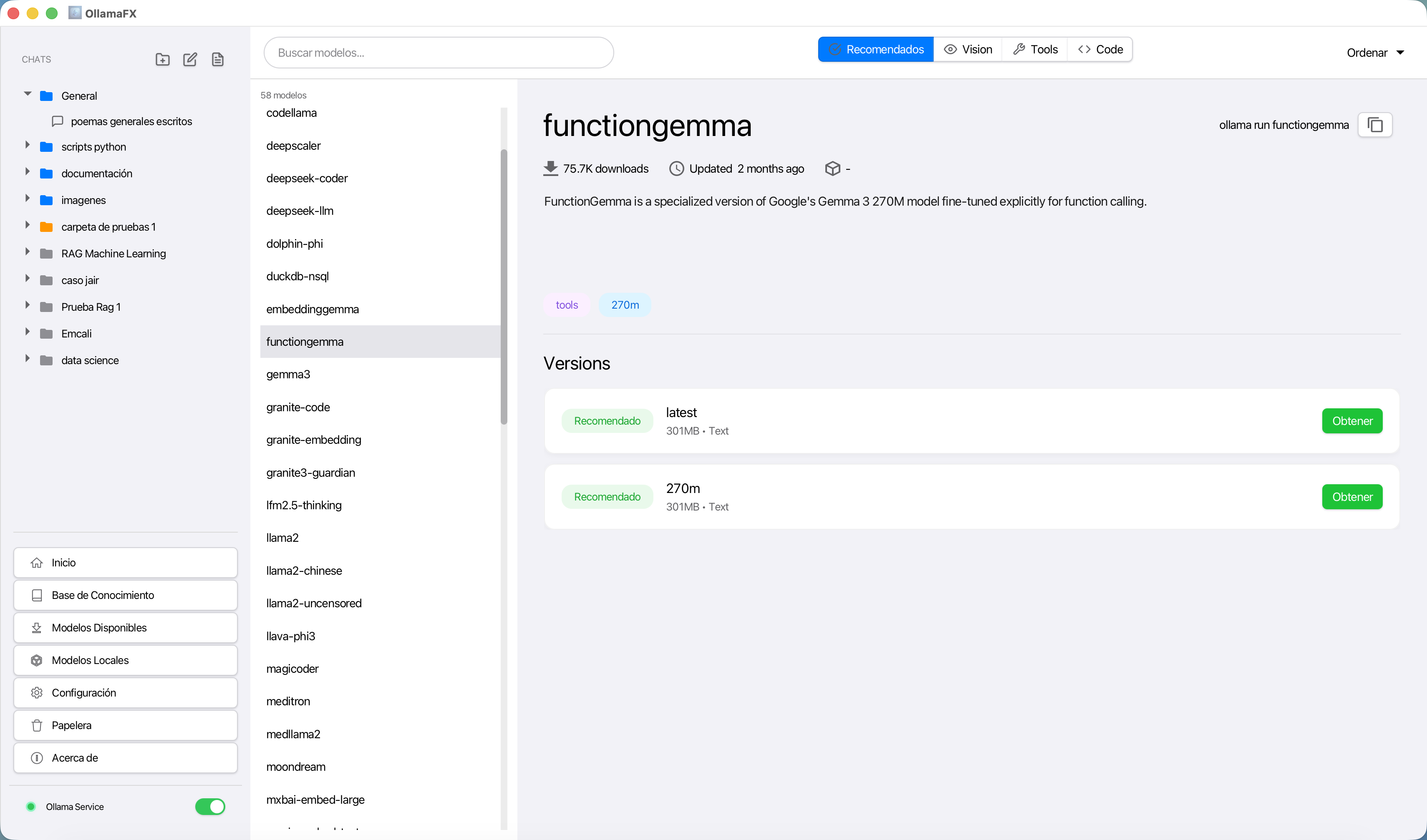

Ollama y el ecosistema para correr LLMs en local de forma sencilla.

1 artículo 1 Tutorial